Nel corso di questo articolo esamineremo nel dettaglio come muovere i primi passi su questo applicativo, sia da browser sia tramite smartphone, analizzando le due modalità principali di creazione: quella semplice e quella avanzata. Non ci fermeremo alla teoria, ma vedremo come l’algoritmo elabora i testi in lingua italiana e come sia possibile gestire la struttura dei brani fino a una durata massima di quattro minuti e mezzo. Inoltre, approfondiremo gli strumenti unici offerti dalla piattaforma, come la scomposizione della traccia nei singoli elementi costitutivi la batteria, il basso, la voce e la parte strumentale e le opzioni di modifica mirata attraverso l’editing di specifiche porzioni audio.

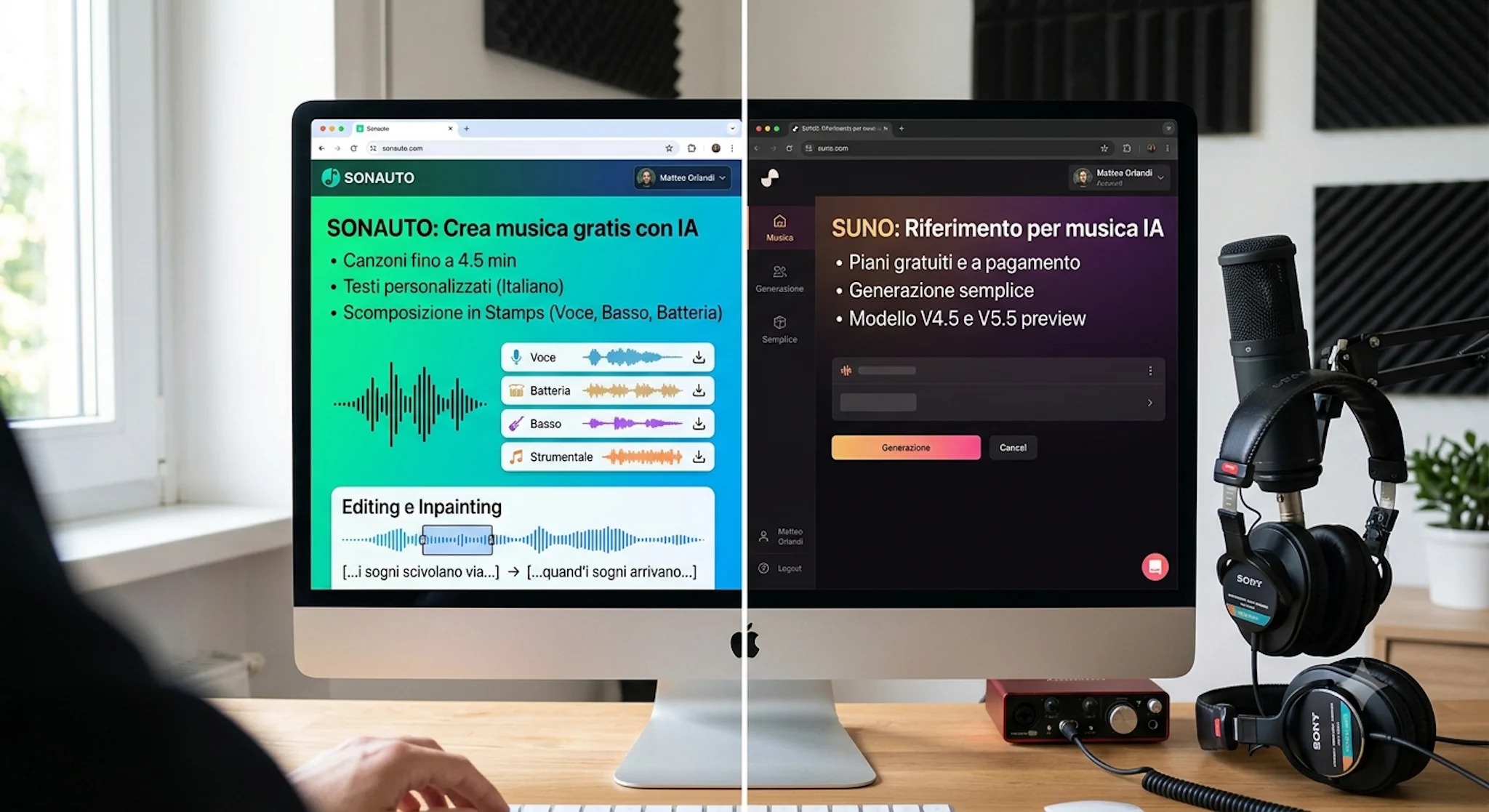

Infine, metteremo alla prova lo strumento attraverso un confronto diretto con il celebre Suno, utilizzando lo stesso identico input per valutare le sfumature e la qualità finale del file generato. Concluderemo con un’analisi dettagliata dei termini di servizio per fare chiarezza sulla questione cruciale dei diritti commerciali e sulla monetizzazione dei contenuti creati. Siete pronti a scoprire come dare vita alle vostre idee musicali? Buona lettura.

Indice

- Cos’è Sonauto e come muovere i primi passi sulla piattaforma

- Le due modalità di creazione musicale tra semplicità e controllo avanzato

- La scomposizione in stamps e la modifica selettiva del testo audio

- Confronto diretto sul campo tra Sonauto e Suno con lo stesso prompt

- Diritti commerciali e monetizzazione cosa dicono i termini di servizio

Tutorial video

Cos’è Sonauto e come muovere i primi passi sulla piattaforma

Quando parliamo di generazione musicale tramite intelligenza artificiale, il pensiero corre immediatamente a piattaforme storiche come Suno, che rappresentano il punto di riferimento del settore. Tuttavia, nel panorama odierno si sta facendo strada un nuovo strumento che potremmo definire come un vero e proprio fratello minore, ma dotato di potenzialità straordinarie: Sonauto. La caratteristica principale che salta subito all’occhio, e che lo rende un tool assolutamente da non perdere, è che in questo momento è completamente gratuito. Non si tratta di una prova limitata, ma di un sistema che non ha limiti di generazione e permette di creare canzoni fino a quattro minuti e mezzo con una qualità complessiva decisamente valida. Bisogna specificare che questa gratuità totale è legata al momento attuale, poiché le logiche commerciali delle piattaforme possono variare nel tempo, ma oggi rappresenta una risorsa incredibile per chiunque voglia sperimentare.

Per iniziare a utilizzare questo applicativo abbiamo a disposizione due strade. Possiamo decidere di utilizzarlo direttamente dal browser del nostro computer, un’opzione che si rivela molto comoda per avere una visualizzazione a schermo pieno e gestire meglio i vari menu, oppure possiamo scaricare l’applicazione ufficiale per smartphone per creare musica in mobilità. L’interfaccia utente ricca di opzioni ricorda molto da vicino quella di Suno, il che renderà la navigazione familiare per chi ha già utilizzato altri sistemi simili. Sulla parte sinistra dello schermo troviamo un menu espandibile che contiene diverse sezioni utili: una barra di ricerca per trovare determinati brani o artisti all’interno della piattaforma, i generi musicali più caldi del momento e persino una funzione radio per ascoltare i brani passati all’interno del sistema o le canzoni segnalate direttamente dallo staff. C’è anche un collegamento diretto alla community di Discord, un luogo pensato per dialogare con altri utenti e fornire feedback agli sviluppatori.

Prima di poter dare sfogo alla nostra creatività e avviare il processo di generazione, l’unico passaggio richiesto è la registrazione di un account personale. Il completamento del login richiede pochissimi minuti e può essere effettuato inserendo semplicemente la propria email o sfruttando le integrazioni rapide con Google, Discord o Apple. Una volta completato l’accesso, avremo a disposizione il nostro profilo personale in cui verranno archiviati tutti i file e i progetti che decideremo di salvare all’interno della nostra libreria. Da questo spazio potremo ascoltare le nostre creazioni, organizzarci e decidere se renderle pubbliche sulla piattaforma per farle trovare agli altri utenti.

A livello puramente tecnico, il sistema mette a disposizione degli utenti due modelli principali di generazione. Il primo è il modello V 2.2, stabile e collaudato, mentre il secondo è il modello V3, attualmente rilasciato in versione preview. Questa versione più recente è quella che permette di raggiungere la durata massima di quattro minuti e mezzo e introduce moltissimi nuovi stili musicali. Tuttavia, trattandosi ancora di una preview, il sistema stesso ci avvisa che in alcuni casi potrebbe produrre risultati di qualità inferiore o mostrare qualche leggera incertezza nell’assemblaggio sonoro. Sperimentare con entrambi i modelli è la scelta migliore per capire quale si adatti maggiormente alle nostre specifiche esigenze.

Le due modalità di creazione musicale tra semplicità e controllo avanzato

Entrando nel vivo dell’utilizzo della piattaforma, ci troviamo davanti a un bivio operativo che definisce il nostro approccio creativo: la modalità semplice e la modalità avanzata. La scelta dell’una o dell’altra dipende esclusivamente dal livello di controllo che desideriamo esercitare sull’output finale e da quante indicazioni vogliamo fornire all’intelligenza artificiale. Nella modalità semplice il processo è ridotto all’osso per garantire la massima rapidità. Tutto ciò che dobbiamo fare è inserire una frase, una richiesta o una descrizione testuale di ciò che abbiamo in mente. Ad esempio, possiamo chiedere una traccia inserendo indicazioni sul genere e sugli strumenti desiderati, e l’algoritmo si occuperà di sviluppare l’intera struttura in autonomia, compresa l’eventuale composizione del testo cantato.

Durante i test abbiamo provato a inserire una richiesta per una canzone rock metal moderna in italiano, specificando la presenza di chitarre elettriche potenti, batterie energiche, un basso aggressivo e una voce maschile intensa. Il sistema permette inoltre di scegliere se generare una traccia normale, ossia cantata, oppure una versione esclusivamente strumentale senza alcuna parte vocale. Una funzione avanzata di grande interesse, che merita di essere testata a fondo, è la possibilità di caricare un audio di riferimento. Questo significa che possiamo dare in pasto alla piattaforma un file già esistente, una canzone o un altro spunto sonoro da cui l’intelligenza artificiale prenderà spunto per la nuova composizione. Una volta impostati questi pochi parametri e cliccato sul pulsante di generazione, il brano viene inserito in una coda di lavoro. Il sistema è piuttosto rapido e ci mostra costantemente la nostra posizione in coda e la percentuale di avanzamento. Quando la traccia raggiunge circa il venti per cento di elaborazione, diventa già parzialmente ascoltabile in anteprima.

Se invece desideriamo un controllo minuzioso, dobbiamo attivare la modalità avanzata, che sblocca una serie di opzioni decisamente più ricca. La prima differenza sostanziale risiede nella gestione degli stili musicali. Invece di affidarci a una descrizione libera, possiamo selezionare manualmente una serie di tag specifici che spaziano dal pop, al rock, al rap, fino alla trap e alla musica urban. Cliccando sui tag, il sistema ci suggerisce elementi simili, mettendoci a disposizione centinaia o forse migliaia di combinazioni, comprese nicchie particolari o stili etnici che difficilmente si trovano altrove. Un’opzione utilissima è il campo denominato evita, in cui possiamo digitare esplicitamente uno stile o un elemento che non ci piace e che l’algoritmo dovrà tassativamente escludere dalla composizione.

Per quanto riguarda le parole della canzone, la modalità avanzata offre tre opzioni: la generazione automatica a cura dell’intelligenza artificiale, la versione strumentale oppure l’opzione personalizzata. Quest’ultima ci permette di incollare un testo interamente scritto da noi, magari strutturato preventivamente con l’aiuto di ChatGPT o nato dalla nostra penna, completo di indicazioni per l’intro, le strofe e il ritornello. Troviamo poi dei selettori numerici per calibrare l’influenza dello stile, che determinano quanto l’algoritmo debba rimanere fedele ai tag inseriti o quanto possa prendersi delle derive creative. Infine, è presente un controllo preciso della durata, tramite il quale possiamo stabilire la lunghezza minima e massima del brano, ad esempio impostando un range compreso tra i tre e i quattro minuti, evitando così tracce troppo brevi o frammentate.

La scomposizione in stamps e la modifica selettiva del testo audio

Uno dei punti di forza più straordinari di questa piattaforma, disponibile in modo completamente gratuito, risiede nella gestione avanzata dei file generati. Quando una canzone ci soddisfa, non siamo costretti a considerarla come un blocco unico e immutabile, ma possiamo accedere a una funzione chiamata stamps. Questa opzione permette di dividere la traccia audio principale in quattro tracce indipendenti che separano gli elementi fondamentali del brano. Avremo così la possibilità di isolare e ascoltare singolarmente la traccia vocale pulita, la traccia contenente solo il basso e la batteria, oppure la versione strumentale complessiva che racchiude tutti gli strumenti musicali escludendo la voce. Sebbene al momento non sia ancora presente una separazione chirurgica per ogni singolo strumento, come ad esempio una traccia dedicata esclusivamente alla chitarra solista, la scomposizione in quattro macro-elementi rappresenta uno strumento eccezionale.

Tutte queste singole tracce separate possono essere scaricate sul proprio computer. Questo significa che se vi piace soltanto la linea vocale di una canzone generata, o se ritenete perfetto il giro di basso e batteria, potete prelevare solo quel file per utilizzarlo nei vostri progetti. La piattaforma prevede anche l’introduzione di una funzione che permetterà di aggiungere una parte strumentale specifica direttamente all’interno di un nuovo progetto sulla base di quella esistente, ricalcando le dinamiche di editing più evolute dei software professionali. Oltre al download dell’audio, il sistema offre un’altra comoda opzione gratuita: la creazione di un video. In pochi minuti, la piattaforma elabora un file in formato MP4 che contiene la traccia audio sovrapposta a un’animazione dell’onda sonora, completata dal testo della canzone che scorre sullo schermo a tempo di musica, ideale per essere condiviso rapidamente sui social media.

Un’altra funzionalità rivoluzionaria è legata alla modifica selettiva del brano tramite lo strumento di inpainting. Immaginiamo di aver generato una canzone che riteniamo perfetta sotto ogni punto di vista, tranne che per una singola frase del testo o per una piccola imprecisione ritmica in un determinato punto. Invece di buttare via tutto e consumare tempo in una nuova generazione da zero, possiamo selezionare il brano e attivare la modalità di modifica. È importante notare che, per questioni tecniche, questa funzione sposta temporaneamente l’elaborazione sul modello V2, poiché il modello V3 preview non la supporta ancora nativamente.

Attraverso un comodo editor visivo, possiamo spostare i cursori avanti e indietro lungo la timeline della canzone per evidenziare con precisione millimetrica l’area temporale che desideriamo modificare, ad esempio una selezione che va da zero a tredici secondi. Una volta isolata la regione audio, possiamo scegliere l’opzione per modificare il testo scritto in quel preciso segmento. Possiamo cancellare la vecchia frase e scriverne una completamente nuova, persino un testo volutamente bizzarro o differente. Cliccando nuovamente sul pulsante di generazione, l’intelligenza artificiale lavorerà esclusivamente su quella porzione di tempo: manterrà la struttura musicale, il ritmo e la melodia del resto della canzone perfettamente identici e inalterati, ma sostituirà la voce e le parole nella zona selezionata inserendo il nuovo testo e raccordandolo in modo fluido con il fango e la musica circostanti.

Confronto diretto sul campo tra Sonauto e Suno con lo stesso prompt

Per valutare la reale efficacia di questo strumento, è indispensabile effettuare un test comparativo sul campo mettendolo direttamente a confronto con Suno, che detiene la leadership in questo settore. Per eseguire un test equo, abbiamo preparato un input unico, elaborato con l’aiuto di ChatGPT, caratterizzato da una richiesta complessa e ricca di sfumature stilistiche e strumentali. Abbiamo richiesto la creazione di una traccia deep house cantata in lingua inglese, ma contraddistinta da bassi molto profondi e potenti. A questo abbiamo aggiunto la richiesta di un’atmosfera mistica e spirituale ispirata alle grandi pianure dei nativi americani, specificando l’inserimento di tamburi tribali, flauti etnici, cori evocativi e suoni della natura come il soffio del vento o aquile in lontananza. Il tutto doveva essere completato da una voce femminile calda e avvolgente, un testo incentrato sul legame ancestrale tra l’uomo, la terra e lo spirito, un beat moderno da festival e una bassline profonda e ipnotica.

Iniziando l’analisi da Suno, abbiamo effettuato la generazione utilizzando il modello V 4.5, che è la versione accessibile per gli account gratuiti, sebbene la piattaforma tenda a mostrare piccoli assaggi del modello V 5.5 a pagamento per invogliare l’utente all’acquisto del piano completo. Il risultato ottenuto su Suno ha mostrato un brano intitolato Vento Antico. Tuttavia, nonostante nel prompt fosse stato esplicitamente richiesto il canto in lingua inglese, l’algoritmo ha elaborato il testo cantando in italiano, con frasi come sento il passo degli spiriti o la terra parla piano ma io la sento qui, siamo terra e spirito. Al di là dell’errore di lingua, la traccia non ha convinto appieno: la struttura è apparsa come una canzoncina mezza dance un po’ generica, mancando di quella potenza profonda e di quella commistione tribale che erano l’anima della richiesta originaria.

Passando poi all’ascolto dello stesso identico prompt inserito all’interno di Sonauto, la risposta dell’algoritmo è stata differente e, per certi versi, più fedele alle aspettative. Il brano è stato generato rispettando la richiesta della lingua inglese, un fattore che spesso influisce positivamente sulla fluidità del canto nei modelli di intelligenza artificiale. L’arrangiamento ha proposto un’introduzione strumentale molto lunga ed evocativa. Sebbene la valutazione della qualità di un brano dipenda molto dai gusti personali e richieda un ascolto attento in cuffia per giudicare la pulizia delle frequenze finali, in questo specifico test comparativo Sonauto ha dimostrato una migliore rispondenza all’idea di base.

Bisogna essere onesti ed evidenziare che quando si utilizza la modalità di generazione semplificata su entrambe le piattaforme, inserendo semplicemente un testo libero, i tool tendono a generare un po’ quello che vogliono, prendendosi ampie libertà interpretative. Suno resta un software incredibile, maturo e superiore per moltissimi aspetti tecnici legati alla pulizia del suono globale, ma Sonauto non sfigura affatto. Al contrario, si difende in modo eccellente, dimostrando che anche un’applicazione completamente gratuita può competere ad armi pari e persino superare il concorrente su determinate tracce, specialmente se l’utente impara a sfruttare le opzioni più complete e complesse della modalità avanzata.

Diritti commerciali e monetizzazione cosa dicono i termini di servizio

Una volta compreso come creare ottima musica e come modificarla, emerge spontaneamente una domanda fondamentale che si pongono tutti i creatori di contenuti: le canzoni generate possono essere utilizzate a livello commerciale? Si tratta di un argomento delicato su cui si leggono spesso pareri molto contrastanti sul web, ed è per questo che è fondamentale andare a leggere direttamente i termini di servizio ufficiali e aggiornati della piattaforma, analizzandoli magari con l’ausilio di modelli linguistici per non incorrere in errori di interpretazione.

Il punto di riferimento assoluto all’interno del contratto di utilizzo è la sezione numero otto. La domanda cruciale è se sia necessario pagare una quota o un abbonamento per avere il permesso di sfruttare i brani, e in questo momento la risposta ufficiale della piattaforma è no. I termini di servizio specificano chiaramente che le canzoni generate appartengono all’utente. Nel momento in cui l’algoritmo sforna il file, Sonauto trasferisce all’utente tutti gli eventuali diritti che la piattaforma stessa potrebbe vantare sull’output generato. L’aspetto più importante da sottolineare è che le limitazioni d’uso commerciale presenti nel resto del contratto non si applicano in alcun modo ai file musicali prodotti dagli utenti.

Cosa significa questo in termini pratici per la nostra attività quotidiana? Significa che, allo stato attuale delle cose, abbiamo la piena libertà di monetizzare i brani su YouTube, di inserire queste tracce come sottofondo musicale all’interno dei nostri video promozionali monetizzati, di utilizzarle come sigle o stacchi nei podcast o di integrarle in qualsiasi tipo di progetto commerciale, incluse le attività di sottofondo per aziende e negozi. Tuttavia, ci sono alcune limitazioni e responsabilità ben specifiche che dobbiamo tenere a mente per evitare passi falsi. Sonauto specifica chiaramente che la responsabilità finale dell’utilizzo della musica ricade interamente sull’utente. La piattaforma non fornisce alcuna garanzia automatica che l’output sia proteggibile da copyright in ogni paese del mondo, né garantisce l’assenza assoluta di future controversie legali.

In parole povere, la piattaforma ci concede tutti i diritti in suo possesso, ma se un domani un terzo soggetto dovesse contestare la traccia sostenendo che somiglia troppo a una melodia esistente, la responsabilità legale sarà esclusivamente nostra. Inoltre, dobbiamo essere consapevoli del fatto che quando creiamo e salviamo una canzone sulla piattaforma, concediamo a Sonauto una licenza d’uso molto ampia e non esclusiva. Questo permette agli sviluppatori di utilizzare le nostre canzoni per mostrare i trend della community o per addestrare e migliorare i modelli futuri di intelligenza artificiale. In conclusione, non sappiamo se il servizio rimarrà gratuito per sempre o se verranno introdotti abbonamenti a pagamento con prezzi differenti in futuro, ma oggi rappresenta uno dei migliori generatori musicali sulla piazza, valido sia per la qualità sia per la flessibilità commerciale che offre a costo zero.

FAQ

Sonauto è un generatore musicale AI gratuito; basta registrarsi con email, Google, Discord o Apple e accedere via browser o app mobile..

Modalità semplice (testo libero) e modalità avanzata (tag, controlli di stile, testi personalizzati)..

Modello V 2.2 stabile e modello V3 in preview, quest'ultimo consente brani fino a quattro minuti e mezzo..

Con la funzione stamps la canzone viene divisa in voce, basso batteria, strumenti e traccia strumentale, tutte scaricabili separatamente..

Sì, lo strumento di inpainting permette di selezionare un intervallo temporale e rigenerare testo o voce mantenendo il resto invariato..

Sì, entrambe le modalità consentono di scegliere la versione senza voce..

I diritti di utilizzo commerciale appartengono all'utente; Sonauto trasferisce tutti i diritti sull'output generato..

Sì, è consentito usare le canzoni per video, podcast, pubblicità o negozi senza pagare ulteriori licenze..

L'utente è responsabile di eventuali contestazioni di copyright e la piattaforma non garantisce l'assenza di dispute future..

Nel test, Sonauto ha rispettato la lingua inglese e ha prodotto una traccia più aderente al prompt, mentre Suno ha generato contenuti in italiano con qualità più generale..

Written by Mokik

Link referral

Tuttavia, tenete presente che i link referral non influenzano il nostro giudizio o il contenuto dell’articolo. Il nostro obiettivo è fornire sempre informazioni accurate, approfondite e utili per i nostri lettori. Speriamo che questi link referral non compromettano la vostra esperienza di navigazione e vi invitiamo a continuare a leggere i nostri articoli con fiducia, sapendo che il nostro impegno è offrirvi sempre il meglio.

Amazon Prime | Amazon Music Unlimited | Prime Video | Amazon Business | Kindle Unlimited | Amazon Wedding List | Prime Student